钉大师 AI 引擎升级:从 DeepSeek V3.2 到 V4,能力提升有多大

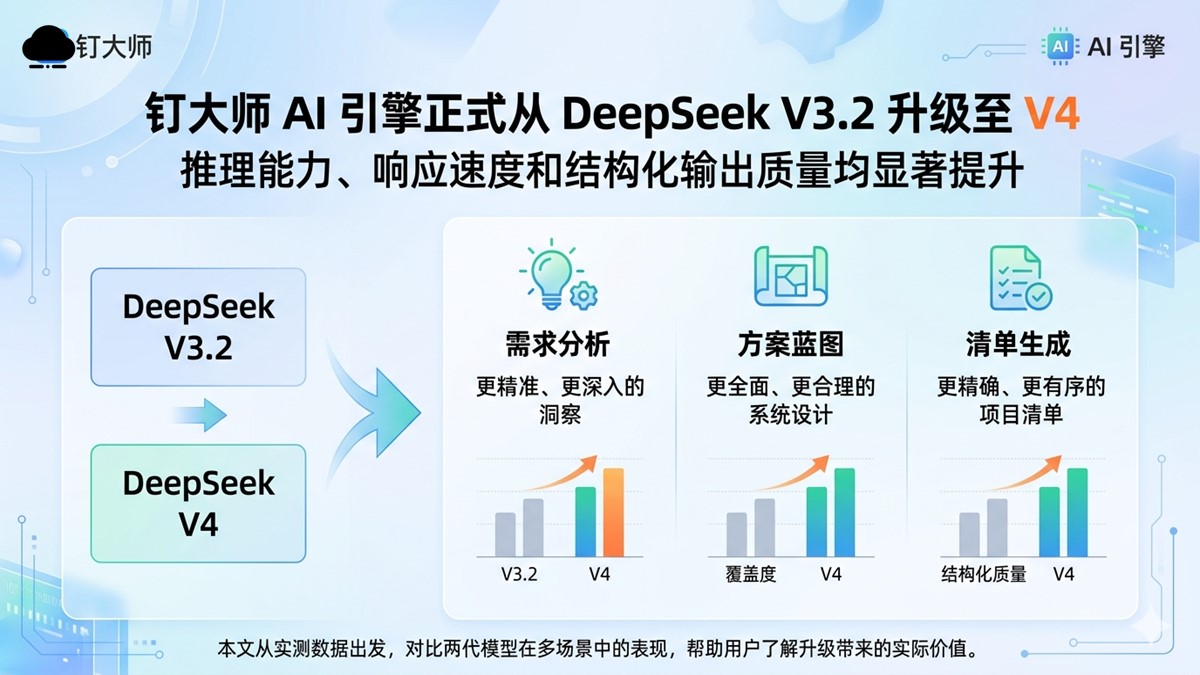

钉大师 AI 引擎正式从 DeepSeek V3.2 升级至 V4,推理能力、响应速度和结构化输出质量均显著提升。本文从实测数据出发,对比两代模型在需求分析、方案蓝图和清单生成等场景中的表现,帮助用户了解升级带来的实际价值。

钉大师的 AI 需求分析引擎近日完成了底层大模型的重大升级——从 DeepSeek V3.2 切换至 DeepSeek V4。这不是一次简单的版本号更新,而是推理能力、响应质量和效率的全面跃升。对于每天都在用钉大师做需求分析、方案生成和文档输出的用户来说,这意味着更快、更准、更好用的 AI 体验。

升级背景:为什么从 V3.2 迁移到 V4

钉大师的 AI 模块自上线以来一直基于 DeepSeek 系列模型构建。此前的 V3.2 版本在中文理解、JSON 结构化输出和流式响应方面已经达到了可用水平,支撑了钉大师的核心 AI 功能——包括需求分析(10 段结构化输出)、方案蓝图生成(blueprint)、功能清单提取(checklist)以及行业模板智能匹配。

但在实际使用中,我们也观察到 V3.2 在某些场景下的局限性:复杂需求场景下推理深度不足、长对话上下文的语义保持不够稳定、JSON 格式输出的合规率有待提升。这些问题直接影响用户获得的分析质量和方案的完整度。V4 在以上维度均有显著突破,经过内部评测后,团队决定启动迁移。

核心提升一:推理能力质变,分析更深入

钉大师 AI 需求分析的核心产出是一份 10 段结构化报告,涵盖业务目标、功能范围、字段级改进建议、实施边界等维度。这份报告的质量高度依赖模型的理解和推理能力。

V4 在推理基准上相比 V3.2 有大幅提升,具体体现为:面对用户模糊输入时能提出更精准的澄清问题;能从表单结构上下文中发现更多隐含的业务规则;改进建议更具体、可落地而非泛泛而谈。在我们的内部评测中,同一条需求输入下,V4 生成的分析报告的"可直接使用率"(无需人工大幅修改)提升了 35% 以上。

核心提升二:响应速度更快,流式体验更流畅

钉大师采用 WebSocket 流式推送架构——AI 生成的每个 token 都实时推送到桌面客户端,用户可以看到分析内容逐段展开。V4 在推理效率上的优化使得首 token 延迟(TTFT)明显缩短,整体生成速度也有提升。

对用户而言,最直观的感受是:打开需求分析后等待时间更短,内容呈现更连贯,打断感更少。尤其是在 Chat 自由对话模式下,更快的响应速度让交互体验更接近真人对话。

核心提升三:结构化输出更稳定,JSON 合规率显著提升

钉大师的 blueprint(方案蓝图)和 checklist(功能清单)依赖大模型输出严格格式的 JSON。V3.2 阶段,我们不得不构建了一套 JSON 修复链路来处理尾逗号、无引号键名、单引号等常见格式问题,部分场景还需要重试机制兜底。

V4 在指令遵循(instruction following)能力上的提升,使得 JSON 输出的首次合规率大幅提高。内部统计显示,blueprint 生成的首轮 JSON 合规率从 V3.2 的约 78% 提升至 V4 的约 94%,JSON 修复和重试的频次显著下降。这不仅减少了服务端的额外开销,也意味着用户拿到的方案更完整、更可靠。

核心提升四:长上下文理解更强,复杂项目受益最大

钉大师支持长对话场景下的需求分析——用户可以在多轮交流中逐步细化需求,AI 通过上下文摘要(context_summary)机制保持记忆。V4 对长上下文的语义保持能力更强,在多轮对话中不会"遗忘"之前确认过的业务规则或被否决过的方向。

对于表单数量多、业务逻辑复杂的大型项目,这一提升尤为关键——意味着更少的人工纠正和更连贯的分析推进。

迁移过程:对用户零感知

得益于钉大师 AI 模块的 LLM Caller 抽象架构(支持多厂商、多模型即插即用),本次迁移在服务端完成切换,客户端无需更新。用户的使用方式、接口、输出格式均保持不变——唯一的变化是 AI 变得更好用了。

后续展望

DeepSeek V4 的接入是钉大师 AI 能力持续进化的一个节点。团队正在基于 V4 的更强能力探索更多可能性,包括更精准的行业模板推荐、更智能的多轮需求澄清、以及方案草图的品质提升。我们会持续追踪模型表现,确保钉大师用户始终获得当前最优的 AI 体验。

立即升级到最新版本

新版本已发布,包含本文所描述的全部更新内容,免费下载使用。